Искусственный интеллект открывает не только новые возможности, но и новые угрозы. С помощью генеративного ИИ злоумышленники создают дипфейки и поддельные сайты, рассылают спам и даже притворяются родственниками и друзьями. Сегодня расскажем, как нейросети используют для мошенничества и фишинга, — и конечно же, поделимся советами о том, как обезопасить себя. Ну а подробный разбор фишинговых схем с использованием ИИ вы найдете на Securelist.

Pig Butchering, кетфишинг и дипфейки

ИИ-боты, притворяющиеся живыми людьми, активно используются злоумышленниками в романтических переписках — мошенники создают выдуманных персонажей и с их использованием одновременно общаются со множеством жертв, устанавливая с ними тесную эмоциональную связь. Подобная переписка может длиться неделями и даже месяцами, постепенно переходя от легкого флирта к обсуждению «выгодных инвестиционных схем», и заканчивается, разумеется, после того, как жертва вложит свои средства в мошеннические проекты. За счет длительного личного общения любые подозрения, которые могли возникнуть у жертвы, понемногу рассеиваются. Подобные схемы называются Pig Butchering, и мы уже подробно описывали их ранее, но если ранее они реализовывались за счет гигантских мошеннических ферм в Юго-Восточной Азии, на которых «работали» тысячи человек, то теперь для подобных разводок все чаще используется ИИ.

Кетфишинг, при котором скамеры создают поддельную личность или притворяются другим реальным человеком, с развитием нейросетей значительно упростился. Современные генеративные нейросети способны достаточно точно сымитировать чью-то внешность, голос и стиль письма. Злоумышленнику достаточно собрать публично доступную информацию о том или ином человеке, а затем «скормить» эти данные ИИ. Пригодится все: фото и видео, публичные посты и комментарии, информация о родственниках, хобби, возрасте и так далее.

Поэтому, если к вам обращается родственник или друг, который почему-то пишет с нового аккаунта и, например, просит у вас денег в долг, — скорее всего, это вовсе не родственник и уж точно не друг. В подобном случае лучшее решение — связаться с реальным человеком по другому каналу, например по телефону, и спросить у него напрямую, все ли в порядке. Не повредит также задать несколько личных вопросов, ответы на которые злоумышленник не сможет найти в открытых источниках и даже в переписке.

Но правдоподобная имитация другого человека в переписке — лишь часть проблемы: есть ведь еще и аудио- и видеодипфейки. Недавно мы рассказывали, как скамеры распространяют дипфейки популярных блогеров и криптоинвесторов в соцсетях: «знаменитости» приглашают подписчиков на персональные консультации, в «эксклюзивные» инвестиционные чаты, разыгрывают денежные призы и дорогие подарки.

Соцсети, впрочем, не единственное место, где оперируют дипфейками: их также генерируют для видео- и аудиозвонков в реальном времени. В этом году женщина из Флориды лишилась 15 тыс. долларов, думая, что разговаривает с дочкой, попавшей в аварию. Мошенники реалистично подделали голос и даже манеру плача девушки.

Эксперты Kaspersky GReAT обнаружили в даркнете предложения по созданию видео- и аудиодипфейков в реальном времени; при этом стоимость услуги зависит от сложности поддельного контента и его длительности и начинается от $30 для голосовых дипфейков и от $50 долларов — для видео. Еще пару лет назад цена за подобные услуги была куда выше — до $20 000 за минуту — и о генерации в реальном времени речи не шло.

В найденных объявлениях предлагаются разные варианты: замена лица в режиме реального времени в видеоконференциях или мессенджерах, замена лица для прохождения верификации или подмена изображения с камеры на телефоне или виртуальном устройстве.

Также злоумышленники готовы предоставить программы для липсинка — синхронизации губ человека на видео с любым текстом, даже на иностранных языках — и инструменты для клонирования голоса, изменения тона и тембра в соответствии с желаемой эмоцией.

Впрочем, наши эксперты не исключают, что значительная часть опубликованных в даркнете объявлений — это скам, цель которого — выманить деньги у заинтересовавшихся покупателей.

Как защититься

- Не доверяйте онлайн-знакомым, с которыми вы не знакомы вживую. Даже если вы общаетесь длительное время и вам кажется, что вы нашли «родственную душу», насторожитесь при любом упоминании криптовалют, инвестиций и иных схем, в которых вам нужно поделиться собственными деньгами.

- Не ведитесь на внезапные заманчивые предложения от лица знаменитостей и крупных компаний в соцсетях. Всегда заходите в их официальные аккаунты и перепроверяйте информацию. Если на каком-то этапе «розыгрыша призов» вас попросят оплатить комиссию, налог или доставку или ввести данные вашей банковской карты для получения денежного приза — остановитесь.

- Связывайтесь с родственниками и друзьями, обращающимися к вам с необычными просьбами, по другому каналу, например по телефону. На всякий случай спросите, о чем вы говорили на последней встрече. В случае с близкими людьми стоит заранее договориться об использовании какой-либо ключевого слова, известного только вам, которое позволит подтвердить личность. Если вы делитесь друг с другом геолокацией, проверьте ее и уточните, где сейчас находится ваш собеседник. Не ведитесь на манипуляции: мошенник или ИИ может говорить вам, что ситуация срочная и что у него нет времени отвечать на глупые вопросы.

- Если вы сомневаетесь в реальности человека при видеозвонке, попросите его повернуться в профиль или выполнить сложное движение руками на камеру. Обычно дипфейк «застревает в текстурах» или вытворяет что-то абсурдное. Если ваш собеседник не моргает, у него странные движения губ или мимика — это тоже «красный флаг».

- Не диктуйте и не пересылайте номера банковских карт, одноразовые коды и другую конфиденциальную информацию.

Пример того, как дипфейк «ломается» при повороте головы. Источник

Автоматизированные звонки

Чтобы не тратить силы на разговоры с жертвами, мошенники с помощью ИИ создают фейковые «автоматизированные звонки» от имени банков, сотовых операторов и сервисов госуслуг. На другом конце линии — «бот из техподдержки», и это не вызывает подозрений: многие компании действительно пользуются голосовыми ассистентами. Правда, они никогда не будут сообщать о взломе аккаунта или просить назвать код из SMS.

В такой ситуации главное — не поддаваться эмоциям и игнорировать мошеннические предупреждения о «взломе аккаунта» или «краже денег». Сбросьте звонок и сами позвоните в компанию по номеру, который указан на их официальном сайте. Учтите, что в современных мошеннических схемах может быть задействовано множество участников, которые будут передавать вас по цепочке от одного к другому, писать и звонить вам с разных номеров, представляясь работниками банков, госслужащими, сотрудниками полиции или силовых ведомств. Мы подробно разбирали изощренную схему обмана, где на одну жертву приходилось аж пять мошенников, в посте Десять уроков, которые я вынесла после того, как меня (почти) развели мошенники.

Фишинг в чат-ботах и агентах

Многие пользователи в наши дни предпочитают не искать информацию через привычные поисковики, а спрашивать у ChatGPT, Gemini и других чат-ботов. Казалось бы, какие тут могут быть риски? Но большие языковые модели обучаются на данных пользователей, и уже известны случаи, когда популярные чат-боты советовали перейти на фишинговые сайты. А при запуске поиска в Сети, ИИ подключается к поисковикам, в которых также могут оказаться фишинговые ссылки.

В недавнем эксперименте исследователям удалось обмануть ИИ-агента в браузере Comet от Perplexity поддельным письмом якобы от инвестиционного менеджера Wells Fargo, одной из крупнейших в мире банковских компаний. Письмо было отправлено исследователями со свежесозданного аккаунта ProtonMail и содержало ссылку на реальную фишинговую страницу, существовавшую к тому моменту уже несколько дней, но до сих пор не помеченную Google Safe Browsing как вредоносная. Разбирая почту и обнаружив письмо, ИИ-агент пометил его как «задачу от банка», без каких-либо проверок перешел по фишинговой ссылке, открыл поддельную страницу входа, предложил пользователю ввести его учетные данные и даже помог заполнить форму! Таким образом, ИИ фактически «поручился» за фишинговую страницу — пользователь не видел ни самого письма с подозрительного адреса отправителя, ни фишинговой ссылки, а сразу попал на страницу ввода пароля, предложенную услужливым ИИ-ассистентом.

В том же эксперименте исследователи с помощью с помощью ИИ-платформы для разработки веб-приложений Lovable создали поддельный сайт, имитирующий магазин Walmart. Затем зашли на него через Comet — то же самое мог бы сделать любой невнимательный пользователь, обманутый фишинговой ссылкой или рекламой — и попросили ИИ-агента купить Apple Watch. Агент изучил поддельный сайт, нашел «выгодное предложение», добавил часы в корзину, ввел адрес и данные банковской карты, сохраненные в браузере, а затем без какого-либо подтверждения совершил «покупку». Если бы это был реальный мошеннический сайт, пользователь не только потерял бы внушительную сумму, но и передал бы злоумышленникам все свои реквизиты.

Увы, ИИ-агенты пока ведут себя как доверчивые новички в Сети и легко поддаются на социальную инженерию. Мы уже подробно рассказывали о рисках интеграции ИИ в браузеры и способах их минимизации, здесь лишь напомним: чтобы случайно не оказаться следующей жертвой слишком доверчивого ассистента, критически относитесь к выдаваемой им информации, не давайте слишком много прав ИИ-агентам и установите надежное защитное решение, которое заблокирует переходы на вредоносные сайты.

Разработка фишинговых сайтов

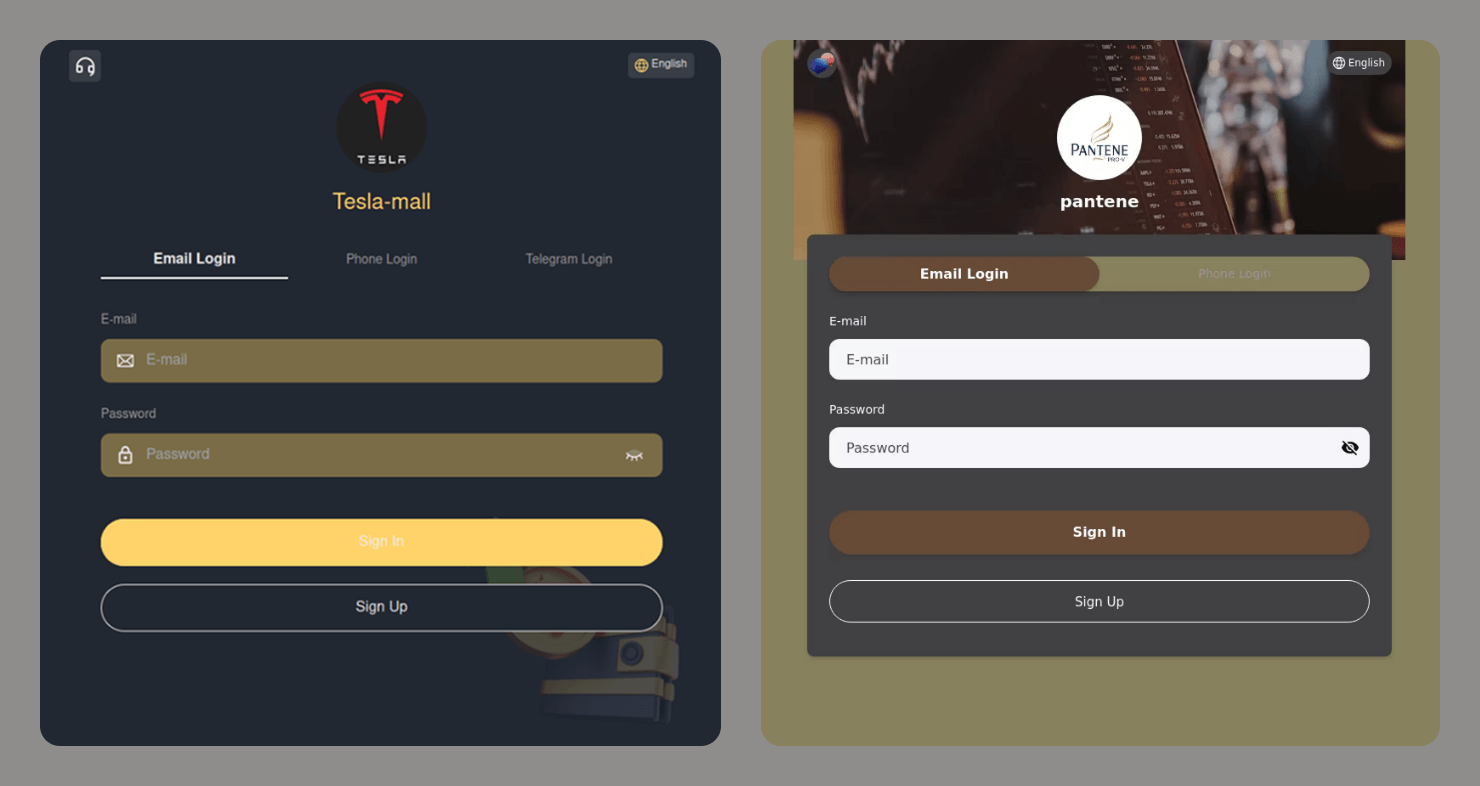

Времена, когда фишинговые сайты кишели навязчивой рекламой и сомнительными дизайнерскими решениями, уже позади. Сейчас злоумышленники стараются создавать реалистичные подделки: с протоколом HTTPS, пользовательскими соглашениями, предупреждениями о сборах куки и более-менее качественным дизайном. Благодаря ИИ-инструментам разработка таких сайтов стала намного дешевле и быстрее (если не почти моментальной). А ссылку на подобный сайт вы можете получить где угодно: в мессенджере, почте, SMS и даже в поисковой выдаче.

Как распознать фишинговый сайт

- Проверьте, есть ли в адресе, названии или материалах сайта опечатки.

- Узнайте, как давно зарегистрирован домен сайта (проверить это можно здесь).

- Обратите внимание на формулировки: пытаются ли вас напугать или обвинить в чем-то? Хотят завлечь или торопят выполнить определенные действия? Любая игра на эмоциях — «красный флаг».

- Включите функцию проверки ссылок в любом из наших защитных решений.

- Если браузер предупреждает вас о незащищенном соединении, покиньте сайт. Легитимные сайты в наше время, как правило, используют протокол HTTPS.

- Введите в поисковой системе название сервиса и сравните имеющуюся у вас ссылку со ссылкой из поисковика. Обратите внимание, что поисковик может показывать рекламные фишинговые ссылки первыми в выдаче, поэтому убедитесь, что рядом со ссылкой нет пометки «Реклама».

Что еще почитать про безопасное использование ИИ:

фишинг

фишинг